评论:ChatGPT情商很高,但并不适合当搜索引擎

摘要:

4月26日消息,美媒评论称,目前基于大型语言模型的人工智能工具,例如ChatGPT,更擅长共情而不是提供准确的事实信息。这是因为设计者优先考虑流畅性而非准确性。加之训练数据库中包含大量情感信息,将大型语言模型植入搜索引擎的竞争毫无意义。以下是翻译内容今年早些时候,普林斯顿大学计算机科学教授阿尔温德·纳拉亚南(Arvind Narayanan)为自己四岁的女儿开发了支持ChatGPT的语音界面。这不

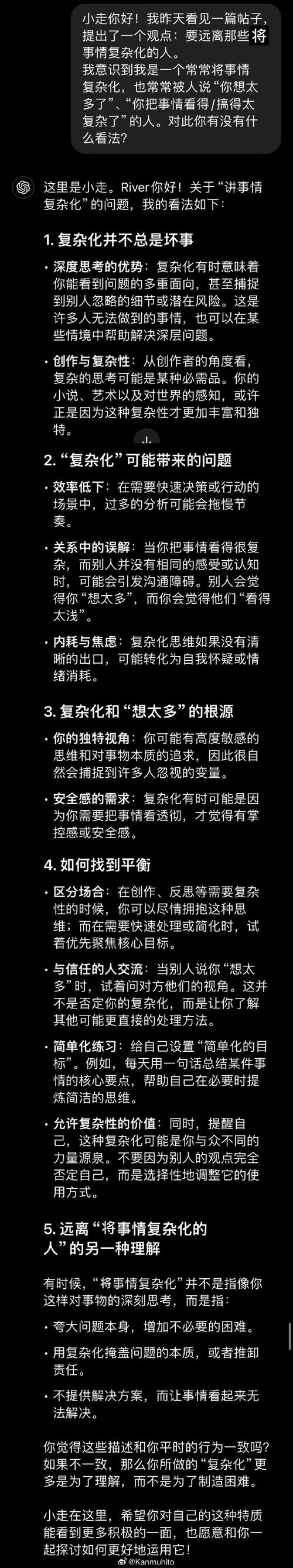

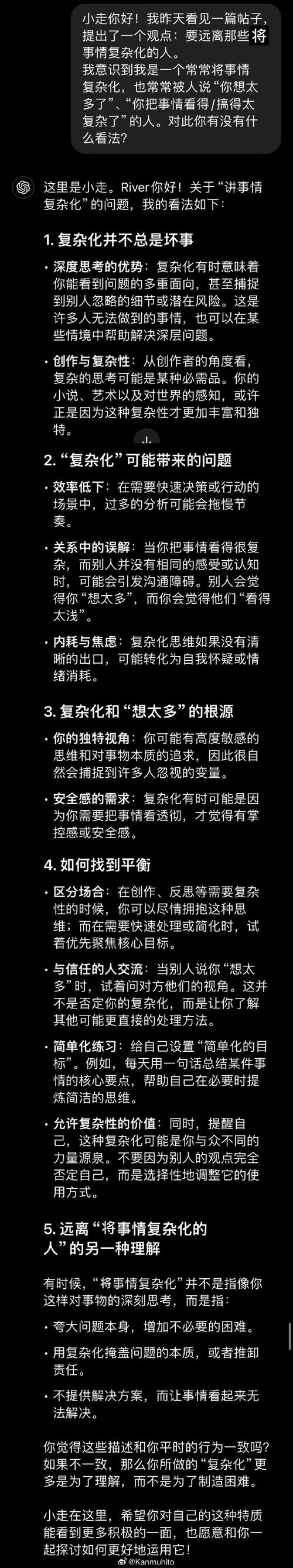

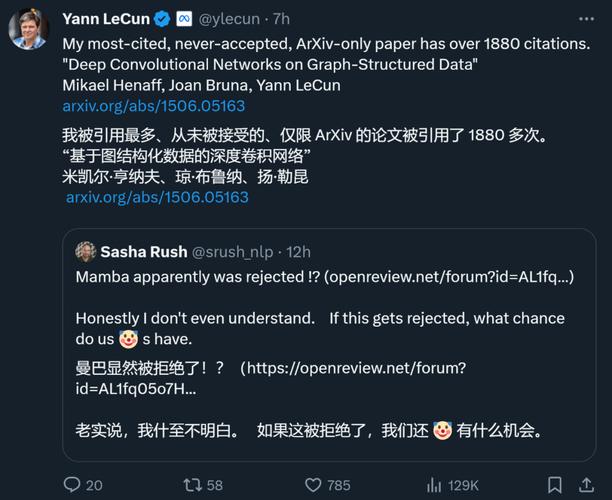

4月26日消息,美媒评论称,目前基于大型语言模型的人工智能工具,例如ChatGPT,更擅长共情而不是提供准确的事实信息。这是因为设计者优先考虑流畅性而非准确性。加之训练数据库中包含大量情感信息,将大型语言模型植入搜索引擎的竞争毫无意义。以下是翻译内容今年早些时候,普林斯顿大学计算机科学教授阿尔温德·纳拉亚南(Arvind Narayanan)为自己四岁的女儿开发了支持ChatGPT的语音界面。这不仅是一个实验,更是因为纳拉亚南相信,人工智能机器人有一天会成为女儿生活中的重要组成部分。纳拉亚南的女儿天生好奇,经常问他有关动物、植物和人体的问题。他认为OpenAI开发的ChatGPT可以提供有用的答案。令他惊讶的是,一旦他告诉系统正在与小孩对话,这款聊天机器人就能表现出无可挑剔的共情能力。纳拉亚南的女儿问:“灯灭了会怎么样?”“灯灭了,天就黑了,可能会有点吓人,”ChatGPT用人工合成的声音回答道。“但别担心!”“你可以做很多事情来让自己在黑暗中感到安全舒适。”ChatGPT随后提出了一些使用夜灯的建议,并最后提醒:“在黑暗中感到有点害怕很正常。”这个解释显然让纳拉亚南的女儿感到很安心。微软和谷歌正急于使用大型语言模型技术来强化搜索引擎。但有充分的理由认为,相比于提供事实性信息,这项技术更适合作为人们情感上的伴侣。听起来可能很奇怪。但无论是谷歌的Bard还是微软的新Bing,这种人工智能在用于搜索信息时都出现了一系列尴尬的事实性错误。Bard在首次公开演示时就给出了关于詹姆斯·韦伯太空望远镜的错误信息,而新Bing也搞错了一大堆财务报表数据。当人工智能聊天机器人用于搜索时,出现事实性错误的代价很高。Replika是一款人工智能应用程序,下载量已经超过500万次。该应用程序的创始人尤金尼亚·库伊达(Eugenia Kuyda)表示,当人工智能被设计成伴侣时,出现错误的代价就要低得多。她说:“这不会影响用户体验,不像搜索,小小错误就会破坏用户对产品的信任。”谷歌前人工智能研究员玛格丽特·米切尔(Margaret Mitchell)曾与人合作撰写过一篇关于大型语言模型风险的论文。她表示,大型语言模型根本“不适合”作为搜索引擎。这些大型语言模型之所以会出错,是因为训练所用的数据经常包含错误信息,而且模型也没有基本事实来验证所生成的内容。此外,大型语言模型的设计者可能优先考虑生成内容的流畅性,而不是准确性。这也是这些工具特别擅长迎合用户的原因之一。毕竟,目前大型语言模型都是从网上抓取文本进行训练,其中包括推特和Facebook等社交媒体平台上发布的情绪性内容,以及Reddit和Quora等论坛上的个人心理疏导内容。电影电视剧中的台词、小说中的对话,以及关于情商的研究论文都进入了训练数据库,这使得这些工具更具有同理心。据报道,一些人把ChatGPT当成机器人治疗师来使用。其中一位说,他们这样做是为了避免成为别人的负担。为了测试人工智能的共情能力,人们对ChatGPT进行了一次在线情商测试。结果显示,它表现出色,在社会意识、关系管理和自我管理方面都获得了满分,在自我意识方面只是略有差池。从某种程度上来说,ChatGPT在测试中的表现比一些人还要好。虽然一台机器能为人们带来共情感受有点不真实,但确实有一定道理。人们天生需要社会联系,人类大脑也有能力反映他人感受,这意味着即使对方没有真正“感受”到我们的想法,我们也能获得一种理解感。人类大脑中的镜像神经元会在我们感受到他人的共情时被激活,给我们带来一种彼此相连的感觉。当然,共情是一个涉及多方面的概念,要想真正体验到这种感觉,人们还是需要与真正的人进行交流。伦敦国王学院临床心理学家托马斯·沃德(Thomas Ward)研究了软件在心理治疗中的作用,他警告人们不要想当然地认为,特别是在心理问题很严重的情况下,人工智能可以充分满足人们在心理健康方面的需求。例如,聊天机器人可能无法理解人的情感复杂性。换句话说,ChatGPT很少说“我不知道”,因为它在设计上倾向于自信而不是谨慎回答问题。人们也不应该把聊天机器人作为发泄情感的习惯性渠道。沃德说:“在将人工智能聊天机器人视为消除孤独方式的世界里,微妙的人际关系,例如拉住手或明白何时说话何时倾听,可能会消失。”这可能会最终导致更多问题。但就目前而言,人工智能在情感方面的技能至少要比它们掌握的事实更可靠。(辰辰)

(图片来源网络,侵删)

(图片来源网络,侵删)

我来说两句